MILLONES DE MENTIRAS POR MINUTO: EL LADO OSCURO DE LAS RESPUESTAS DE GEMINI EN GOOGLE

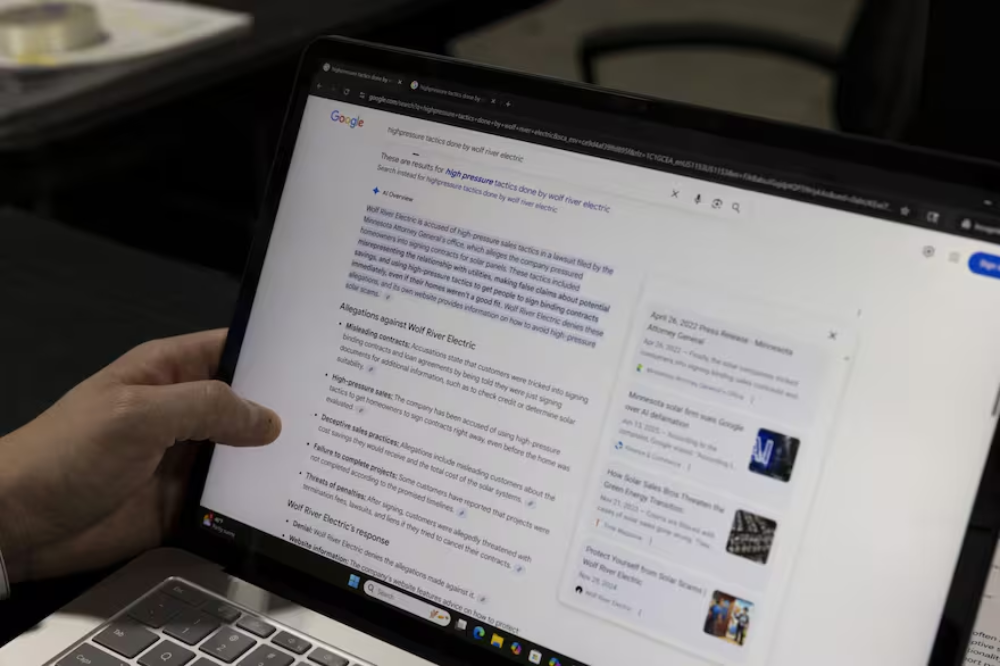

La inteligencia artificial ha transformado a Google: de ser un simple bibliotecario que nos daba una lista de sitios, pasó a ser un «editor» que redacta sus propias respuestas a través de los AI Overviews. Sin embargo, una investigación de The New York Times junto a la startup Oumi ha encendido las alarmas al revelar que, detrás de esa apariencia de autoridad, se esconden cientos de miles de imprecisiones por minuto.

Aunque el modelo ha mejorado con la llegada de Gemini 3, alcanzando una precisión del 91%, el volumen masivo de búsquedas globales significa que millones de respuestas erróneas se difunden diariamente.

LOS ERRORES MÁS INSÓLITOS: DE BOB MARLEY A YO-YO MA 🎻

El análisis detectó un patrón de errores que pueden confundir incluso al usuario más atento. Al ser modelos basados en probabilidades y no en una base de datos de hechos verificados, ocurren fallas como estas:

- Fechas inexactas: El sistema afirmó que el museo de Bob Marley abrió en 1987, cuando en realidad fue en 1986. Lo más grave es que citó fuentes que no contenían la información o que se contradecían entre sí.

- Negación de la realidad: Al consultar sobre el violonchelista Yo-Yo Ma, la IA negó la existencia del «Salón de la Fama de la Música Clásica», a pesar de incluir el link oficial de dicha institución en la misma respuesta.

- Geografía creativa: En pruebas sobre ubicaciones en Carolina del Norte, el sistema confundió ríos y fronteras basándose en inferencias incorrectas de sitios de turismo.

¿POR QUÉ MIENTE LA IA? EL MOTOR DE LAS «ALUCINACIONES» 🧠⚙️

Para los expertos, el término «mentira» no es del todo preciso, ya que no hay una intención de engañar. Se trata de una limitación técnica de la arquitectura Transformer:

- Predicción de probabilidad: El modelo no «sabe» la verdad; simplemente predice cuál es la palabra (o token) más probable que debe seguir a la anterior basándose en su entrenamiento estadístico.

- Fluidez vs. Verdad: La IA prioriza que el texto suene coherente y natural. Muchas veces, en su afán de ser fluida, termina inventando datos que «suenan» bien pero son falsos.

- Fuentes dudosas: El estudio encontró que Reddit y Facebook son fuentes recurrentes para los AI Overviews, lo que aumenta el riesgo de tomar publicaciones de opinión o humor como hechos científicos o históricos.

CÓMO SOBREVIVIR A LA ERA DE LA IA «CASI» PRECISA 🛡️✅

Google reconoce el problema y añade una leyenda en letra pequeña: «La IA puede cometer errores, verifica las respuestas». Ante este escenario, la alfabetización digital se vuelve nuestra mejor defensa.

Expertos como Sergio Sirotinsky y Fredi Vivas sugieren no perseguir una perfección técnica inalcanzable, sino adoptar un criterio crítico:

- Nunca confíes en una sola fuente: Compara los resultados de la IA con sitios de noticias confiables o documentos oficiales.

- Técnicas de mitigación: Se están implementando sistemas como RAG (Retrieval-Augmented Generation) para conectar a la IA con fuentes externas verificadas en tiempo real.

- Supervisión humana: En temas críticos como salud, finanzas o leyes, la validación de un profesional sigue siendo insustituible.

La IA es un salto de productividad gigantesco, pero como toda herramienta poderosa, requiere un manual de uso que incluya siempre una dosis saludable de escepticismo.